Auf Instagram verbreitet: 'All Eyes on Rafah' zeigt die Grenzen von KI-Bildern | Release #196

cover image by mori_hero

Kennen Sie dieses Bild?

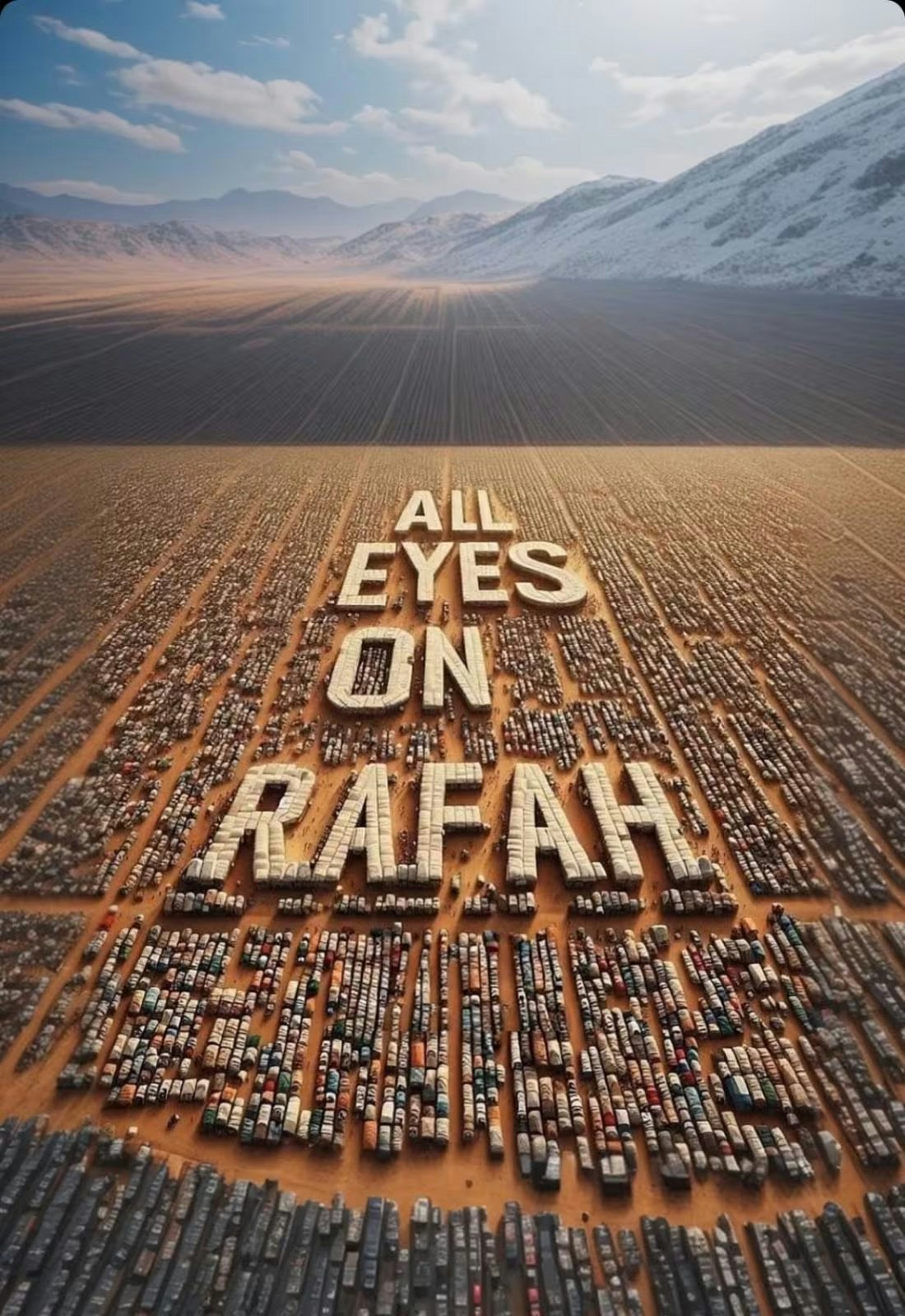

In letzter Zeit ist das KI-Bild mit dem Slogan 'All Eyes on Rafah' auf Instagram sehr viral geworden, und es gibt einen Aufruf, echte Fotos in sozialen Medien zu teilen. Dieses Phänomen zeigt, dass KI-generierte Bilder erstmals in einer groß angelegten Kampagne verwendet wurden.

Warum sind KI-Bilder problematisch?

'All Eyes on Rafah' ist ein Slogan, der Aufmerksamkeit auf Rafah im Gazastreifen lenkt, um internationales Interesse an den Schwierigkeiten der Bewohner zu wecken und humanitäre Hilfe sowie politische Lösungen zu fordern.

Der Hintergrund der Kritik am ursprünglichen 'All Eyes on Rafah'-Bild liegt darin, dass es von KI generiert wurde.

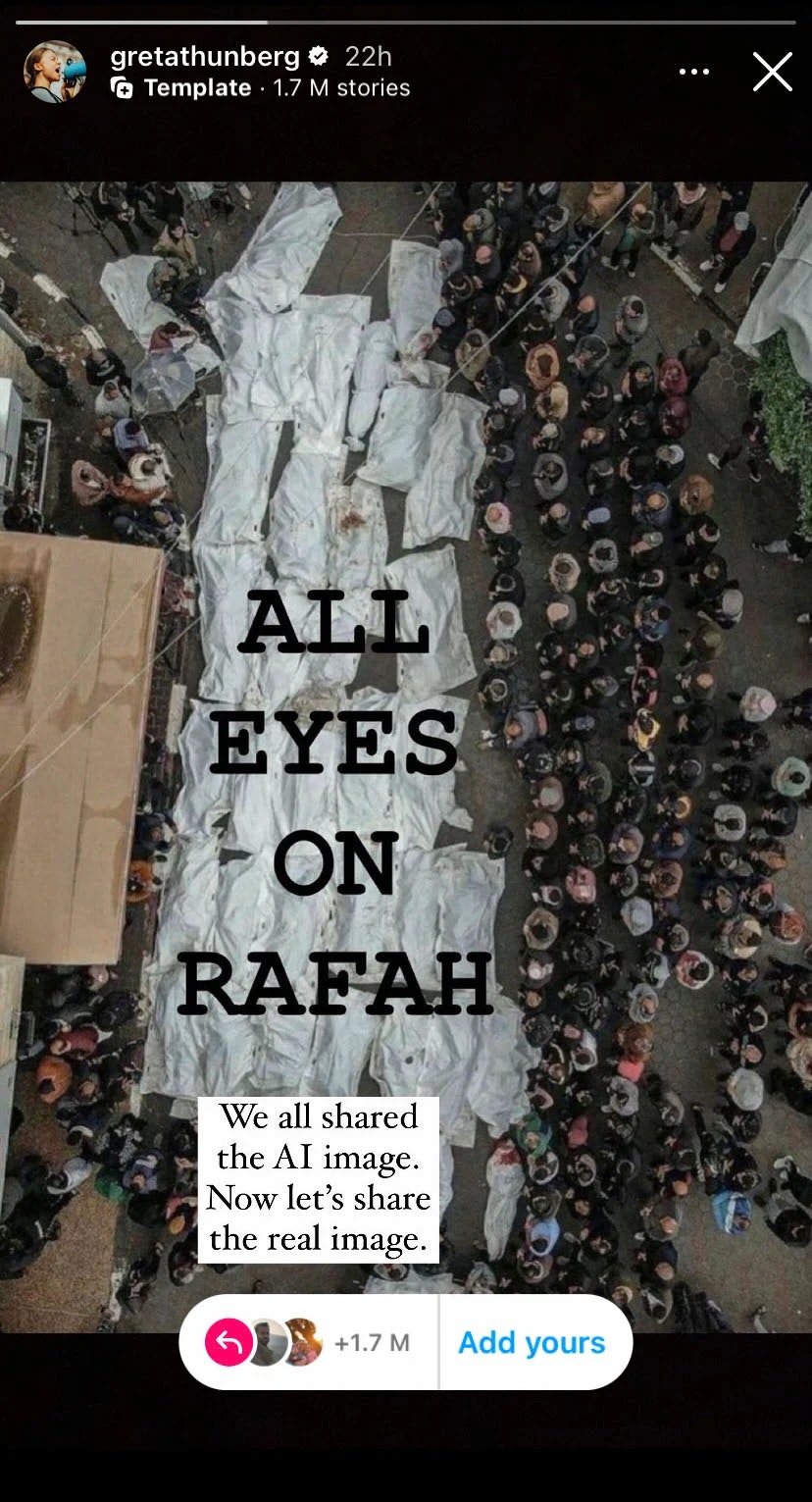

Deborah Brown von der 'Human Rights Watch Group' fragt sich, warum ein gefälschtes Bild über 40 Millionen Mal geteilt wurde, obwohl es echte Bilder gibt, die die Realität des Krieges zeigen. 'Menschen posten sehr grafische und beunruhigende Inhalte, um das Bewusstsein zu schärfen. Es ist beunruhigend, dass synthetische Medien viral werden, während echte Inhalte zensiert werden', sagt Brown.

Das neue 'All Eyes on Rafah'-Foto

Das Bild, das jetzt zusammen mit dem Slogan gepostet wird, ist ein echtes Foto von in Tüchern gewickelten Leichen, die bei einem Bombenangriff ums Leben kamen. Dieses neue Bild wurde bereits fast 2 Millionen Mal geteilt. Das Foto, das von der schwedischen Klimaaktivistin Greta Thunberg geteilt wurde, enthält den Text: 'Wir haben alle das KI-Bild geteilt. Jetzt teilen wir das echte Bild.'

Der Beginn von 'All Eyes on Rafah'

Das ursprüngliche KI-generierte Bild wurde über 47 Millionen Mal geteilt. Der Ausdruck 'All Eyes on Rafah' stammt von Richard Peeperkorn, einem Vertreter der Weltgesundheitsorganisation (WHO), der im Februar vor den Angriffen der israelischen Armee auf Rafah warnte. Laut BBC wurde dieses KI-Bild erstmals auf einem kleinen Instagram-Account eines jungen malaysischen Jungen gepostet.

Die aufgedeckten Probleme von KI-Bildern

Dieses Bild wurde kritisiert, weil es real wirkt, aber nicht zu tatsächlichen Handlungen führt. Einige Menschen nennen dies 'Slacktivism'. Der Pulitzer-Preisträger und Fotograf Daniel Etter kritisierte auf Instagram, dass dieses Bild nichts mit Gaza zu tun hat. 'Gaza ist ein Ort mit schneebedeckten Bergen, zerstörten Gebäuden und begrabenen Leichen, verbrannten Zelten und Müll, menschlichen Überresten. Wenn man es einmal gerochen hat, vergisst man diesen Geruch nie.'

Die Kraft echter Fotos

In Kampagnen wie dieser war es schon immer üblich, echte Fotos auf sozialen Medien zu teilen. Aber es ist das erste Mal, dass KI-Bilder verwendet wurden.

Echte Fotos haben die Kraft, durch ihre Realität und Empathie viele Menschen stark zu beeinflussen. Angesichts der zunehmenden Nutzung von KI-Bildern ist es wichtig, sich stets der Zuverlässigkeit der Informationen und ihrer Auswirkungen bewusst zu sein.

Bei cizucu veröffentlichen wir auch andere aktuelle Informationen. Registrieren Sie die App und schauen Sie sich das täglich erscheinende Magazin an.